Robocop, Terminator… et si les combattants robotisés n'étaient plus de la science-fiction ? Il semble bien que l'humanité soit au bord d'un basculement important. Après les drones, il se pourrait que très bientôt des robots tueurs, guidés par de l'intelligence artificielle, rejoignent les cohortes humaines sur les champs de bataille, voire les remplacer dans un avenir proche… Comment contrôler cette intelligence artificielle à usage militaire ? Comment se prémunir contre l'utilisation de "robots tueurs" autonomes ? C'est le sujet présenté par deux députés, Claude de Ganay, député Les Républicains du Loiret, et Fabien Gouteffarde, député LREM de l'Eure.

"Ce n'est pas de la bombe qu'on a peur... c'est des gens qui peuvent la lancer"

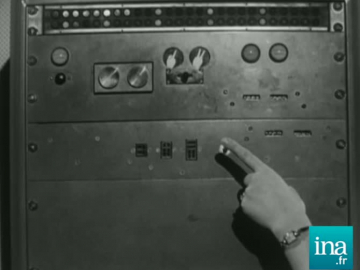

Des questionnements anciens, apparus avec l'avènement de l'intelligence artificielle. Ainsi, dès 1972, bien que l'existence de tels robots soit encore de l'ordre de la science-fiction, certains chercheurs réfléchissaient déjà sur la future autonomie de ces combattants informatiques. Notamment Michel Melkanoff, alors directeur de l'informatique de l'Université de Californie à Los Angeles. Pour lui, aucune inquiétude à avoir... tant que l'homme reste raisonnable.

"Alors bien-sûr, n'est-ce pas, il y a des gens qui ont peur des machines. Ils ont peur de machines qui un jour deviendront des robots super-humains et qui, soit disant, vont conquérir le monde et toutes sortes d'autres histoires à la science-fiction. J'ai quelques mots à dire là-dessus. Tout d'abord, avoir peur veut dire : avoir la crainte d'une pile de fils de fer et de métal ! Ce n'est pas raisonnable", déclare-t-il sur un ton volontairement ironique.

Mais le journaliste lui rappelle tout de même que : "la bombe atomique, c'était aussi une pile de …", le scientifique l'interrompt, "bien-sûr, mais ce n'est pas de la bombe qu'on a peur, c'est des gens qui peuvent la lancer. Dans ce sens, s'il y a peut-être une crainte à avoir, c'est quant aux hommes qui peuvent se servir de l'ordinateur. Maintenant, bien-sûr, les hommes peuvent s'en servir mal. L'Automobile a été aussi poussée pour en faire un tank et c'est un objet de destruction. Un tank auquel on peut même ajouter des commandes télé-automatiques, de telle façon qu'ils peuvent détruire, sans même que les hommes soient là pour les soutenir".

Les banques de données, une arme très puissante, "Il faut donc une certaine surveillance pour empêcher l'abus"...

Il poursuit sur le rôle essentiel des humains dans cette affaire et sur le contrôle de l'information, l'arme par excellence selon lui. Il dresse d'ailleurs un sombre panorama du pouvoir que le mauvais usage de ces "banques de données", quasi inexistantes alors, auraient sur le contrôle de l'humanité : "quiconque a le contrôle des informations a un énorme contrôle sur un groupe, qui devient de plus en plus important. Ainsi, nous voyons avec certaines raisons, une crainte de la possibilité que les banques de données..." avant de poursuivre, il explicite ce terme méconnu à l'époque et qui aujourd'hui régissent notre quotidien, "les banques de données, ce serait par exemple des informations sur toutes sortes de gens qui seraient codées, classifiées et ensuite placées dans la mémoire d'une machine de telle façon qu'on pourrait, très rapidement et très commodément, sortir toutes les informations que l'on voudrait sur quiconque que vous voudriez. Alors, ce genre de choses signifie que vous êtes tous sous le contrôle du "grand frère". Mais le "grand frère" ce n'est pas la machine, c'est l'homme qui s'en sert ! Alors si cet homme le veut, il peut de cette façon vous contrôler et vous tenir, vous serrer la vis tant qu'il veut. Mais pour cela, il faut donc empêcher que les hommes abusent de la machine".

"Toute chose scientifique, technique, tourne en problème politique en fin du compte !"

Il poursuit en donnant l'exemple de débats sur ce sujet et préconise déjà une réglementation, "par exemple, aux Etats-Unis, nous avons en ce moment un procès dans lequel il y a un groupe qui était en train d'essayer de forcer le gouvernement des Etats-Unis à ne pas créer de banques de données, à moins qu'il donne des garanties que ces banques ne seront pas utilisées par qui que ce soit sans permission spéciale. Il faut donc une certaine surveillance pour empêcher l'abus".

Le journaliste l'interroge, "donc la machine, c'est un problème politique ?"

Michel Melkanoff acquiesce, "toute chose scientifique, technique, tourne en problème politique en fin du compte. Aussi bien ceux-ci que l'électricité, que la puissance. Tout ce que vous voudrez".

Pour aller plus loin

Des enfants imaginent les robots soldats... "Un jour, il y aura peut-être une guerre d'ordinateurs…"

Dans la même émission, Edward Fredkin, spécialiste américain de l'intelligence artificielle et ancien pilote de l'armée de l'air, directeur du projet MAC au MIT, interroge ses enfants sur la manière dont ils imaginent l'interaction future entre les hommes et les machines.

"Qu'est ce qui se passera si les ordinateurs deviennent de plus en plus intelligents et qu'il y a des robots vivants?", leur demande-t-il.

"J'aimerais avoir un robot comme professeur, lui répond l'un de ses fils, s'il te crie trop dessus tu peux l'éteindre en tournant le bouton", se plait-il à imaginer.

Son second fils lui explique qu'un jour un ordinateur pourra lui-même fabriquer un autre ordinateur. Fredkin valide, "c'est vrai, un jour un ordinateur pourra programmer un autre ordinateur", son fils lui répond que ce sera bientôt et ajoute "un jour quand ils seront nombreux, ils pourront tout détruire… Un jour, il y aura peut-être une guerre d'ordinateurs…"

Son père le questionne, "tu veux dire que les ordinateurs pourraient nous remplacer, se battre à notre place ? Il n'y aurait plus de blessés ou de morts ?"

"non, ils se battraient ensemble, sans nous…", son frère l'interrompt et ajoute très judicieusement, "un ordinateur ne ferait pas la guerre, sauf s'il y avait une erreur dans son programme…"

Edward Fredkin en profite pour leur expliquer l'importance d'une bonne programmation, "c'est très important de faire attention à la façon dont on programme les ordinateurs futurs. Parce que si on fait une faute, ça pourrait être dangereux".

C'est justement le sujet abordé par les deux députés ce 22 juillet au Sénat dans leur rapport parlementaire sur les SALA, les systèmes d'armes létaux autonomes. Ils estiment qu'"en aucun cas la décision de tir ne pourrait être confiée à un système autonome" et que la France doit pousser à une réglementation internationale très contraignante".

Regarder l'intégralité de cette émission sur Madelen

Un certain regard : l'intelligence artificielle (26 juin 1972)

et visionnez quelques extraits de cette émission

John Mc Carthy et l'intelligence artificielle. A l'époque, la recherche éprouve un certain mépris quant à l'intelligence artificielle mas "mais je crois qu'à la longue, c'est vraiment possible… nous voudrions obtenir une machine la plus intelligente que possible. Un robot qui sera plus intelligent que l'être humain pourrait voir le jour. Est-ce que nous en ferons bon usage si nous la possédions ? …"

Edward Fredkin, la machine sera la prochaine étape de l'évolution… pas l'homme. Selon lui, ces machines auront une conscience mais a priori pas d'émotions. Elles ne seront pas meilleures que les êtres humains mais plus intelligentes. Le danger pour lui, c'est quand l'homme voudra utiliser ces machines à ses propres fins, mais il reste très optimiste en ce qui concerne l'avenir.

Quelques sujets JTs récents sur les robots militaires

20 heures le journal de France 2 : des robots militaires américains. L'armée américaine expérimente un robot miniature équipé d'une caméra et d'un micro. "Pacbot" commandé à distance, sert d'éclaireur aux soldats et sécurise les zones dangereuses. Interview de Joe Dyer, directeur général d'I-Robot, "c'est l'extension du soldat". (14 avril 2004)

20 heures le journal : les robots soldats américains. L'armée américaine a mis au point des robots soldats commandés à distance. Le point sur cette nouvelle arme américaine qui sera bientôt utilisée en Irak. Le reportage alterne des images factuelles avec l'interview d'Arnes Mongolis. Le robot, "le soldat du futur, celui qui n'a pas peur mais surtout, celui qui ne meure pas..." (8 décembre 2004)

13 heures de France 2 : Milipol : les robots des forces de l'ordre. A Paris, le salon Milipol présente notamment des robots "CRS" destinés aux policiers et gendarmes et spécialisé dans le maintien de l'ordre, ainsi qu'aux militaires. Images de vidéos démonstrations "Technorobot" et "I-Robot". (18 octobre 2011)

Vidéo rushes AFP : en Corée du Sud, les premiers pas d'un robot géant. Il marche comme un humain mais fait trembler le sol sous son poids : un robot sud-coréen de quatre mètres de haut, contrôlé par un pilote installé dans son torse, a fait ses premiers pas sous les yeux de journalistes. (27 décembre 2016)

19/20 Edition nationale de France 3 : armée : le salon des forces spéciales. Reportage consacré au Salon Sofins, salon dédié aux nouveautés technologiques du matériel des forces spéciales de l'armée. Commentaire sur images factuelles en alternance avec des interviews de Benoît de Saint-Sernin, organisateur du salon, Brad Metheson, président de la société Priority 1 Air Rescue, d'un responsable du programme "e Rider Safran" et de Spyrus Lezerides, chef des forces spéciales chypriotes. (29 mars 2017)

Et l'émergence d'autres robots...

Grand Soir 3 : les robots à l"assaut du monde. Portrait de Pepper, robot compagnon. L'industrie robotique se développe. Notamment avec les robots compagnons comme Pepper, conçu en France en partenariat avec l'Institut des systèmes intelligents et de robotique (ISIR) de l'université Pierre et Marie Curie. Egalement avec les robots industriels, tel Baxter de Rethink Robotics. La reconnaissance faciale se développe avec l'intelligence artificielle. Le Forum de Davos a accueilli son premier invité robot, Hubo. Le cabinet de conseil stratégique Roland Berger dresse une carte du monde hommes-machines avec les usages et des risques associés. L'Ecole des mines de Paris travaille quant à elle sur le cadre juridique, tout comme un cabinet d'avocats qui travaille sur un droit des robots. Les militaires ne sont pas en reste avec des robots tueurs. L'ONU s'est penchée sur cette problématique des robots autonomes armés destinées à tuer, avec une demande de moratoire rejetée. Images des différents types de robots, notamment Boston Dynamics. Interviews du concepteur du robot Pepper. (26 mai 2016)

Florence Dartois